Nội dung chính

Việc Anthropic cấm nhà sáng lập OpenClaw truy cập Claude đã làm dấy lên làn sóng tranh cãi gay gắt về ranh giới giữa chính sách sử dụng và tham vọng độc quyền hệ sinh thái AI.

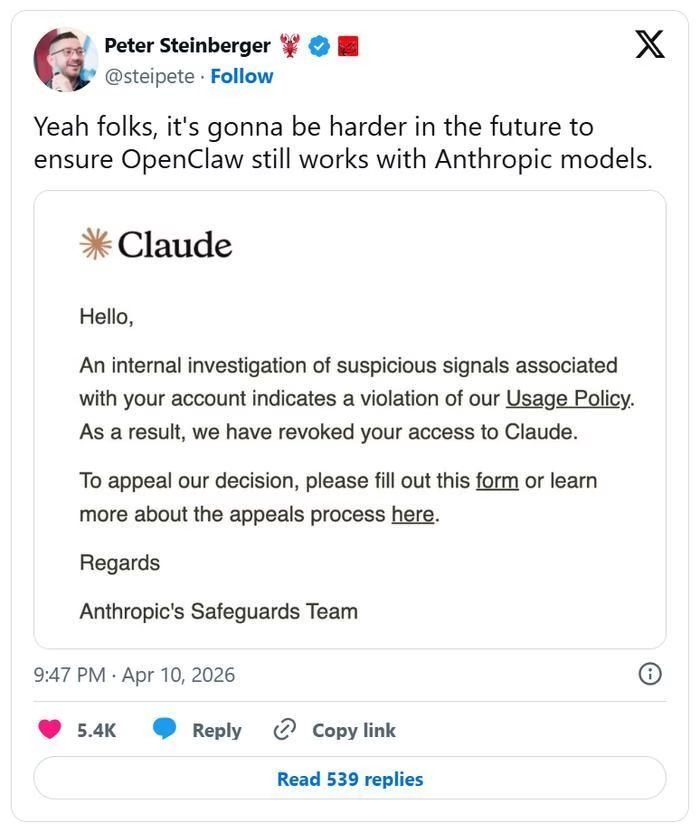

Sự việc bắt đầu khi Peter Steinberger, người đứng sau OpenClaw, bất ngờ nhận được thông báo đình chỉ tài khoản từ Anthropic với lý do “hoạt động đáng ngờ”. Ngay lập tức, Steinberger đã chia sẻ sự việc lên X (Twitter), cảnh báo cộng đồng rằng việc duy trì OpenClaw trên các mô hình của Anthropic sẽ ngày càng trở nên khó khăn.

Dù tài khoản được khôi phục chỉ sau vài giờ khi vụ việc trở nên viral, nhưng những gì diễn ra sau đó đã phơi bày một cuộc xung đột sâu sắc hơn về chiến lược kinh doanh và triết lý phát triển AI.

“Thuế Claw” và chiến lược thắt chặt quyền truy cập của Anthropic

Trước khi vụ cấm xảy ra, Anthropic đã thay đổi chính sách: các gói đăng ký Claude thông thường sẽ không còn hỗ trợ các công cụ bên thứ ba như OpenClaw. Điều này buộc người dùng phải chuyển sang sử dụng API trả phí riêng lẻ — một động thái mà cộng đồng gọi mỉa mai là “thuế claw”.

Lý do kỹ thuật hay rào cản kinh doanh?

Anthropic lập luận rằng các công cụ như OpenClaw tiêu tốn tài nguyên khổng lồ. Khác với những câu lệnh (prompt) đơn lẻ, các AI agent thường chạy vòng suy luận liên tục (looping reasoning), tự động lặp lại tác vụ và kết nối đa nền tảng, gây áp lực lớn lên hạ tầng máy chủ.

Nghi vấn “sao chép rồi chặn đứng”

Tuy nhiên, Steinberger đưa ra một góc nhìn sắc sảo hơn. Anh cho rằng Anthropic đang áp dụng chiến thuật: sao chép các tính năng phổ biến từ mã nguồn mở vào hệ thống đóng của họ, sau đó chặn các giải pháp độc lập. Minh chứng là sự ra đời của Cowork — agent riêng của Anthropic với tính năng Claude Dispatch cho phép điều khiển từ xa, ra mắt ngay trước thời điểm chính sách giá với OpenClaw thay đổi.

Xung đột lợi ích: Mối liên kết giữa OpenAI và Anthropic

Một tình tiết khiến vụ việc thêm kịch tính là việc Peter Steinberger hiện đang làm việc cho OpenAI — đối thủ trực tiếp của Anthropic. Nhiều ý kiến cho rằng đây mới là nguyên nhân thực sự dẫn đến lệnh cấm, thậm chí có người nhận định anh đã “chọn sai phe”.

Đáp trả những nghi ngại, Steinberger khẳng định anh sử dụng Claude thuần túy cho mục đích kiểm thử (testing). Mục tiêu là đảm bảo OpenClaw hoạt động ổn định nhất cho người dùng Claude — nhóm đối tượng hiện đang ưa chuộng OpenClaw hơn cả người dùng ChatGPT.

Anh nhấn mạnh: “Bạn cần tách biệt hai việc: công việc tại OpenClaw Foundation để đảm bảo tính tương thích đa mô hình, và công việc tại OpenAI để hỗ trợ chiến lược sản phẩm tương lai.”

Góc nhìn chuyên gia: Xu hướng “vườn tường bao” trong kỷ nguyên AI

Vụ việc này không đơn thuần là một lỗi vận hành tài khoản, mà là ví dụ điển hình cho xu hướng Walled Garden (Vườn tường bao). Các ông lớn AI đang dần chuyển dịch từ việc hỗ trợ hệ sinh thái mở sang kiểm soát tuyệt đối luồng dữ liệu và cách người dùng tương tác với mô hình để tối đa hóa lợi nhuận.

Khi các AI agent trở thành trung tâm của năng suất lao động, ai kiểm soát được “cổng truy cập” (gateway) sẽ nắm quyền sinh sát đối với các ứng dụng bên thứ ba. Bài học cho các nhà phát triển Open Source là không nên quá phụ thuộc vào một API duy nhất mà cần xây dựng chiến lược đa mô hình để tránh bị “giam cầm” bởi chính sách của một nhà cung cấp.

Theo bạn, việc các công ty AI thu phí cao đối với công cụ bên thứ ba là bảo vệ tài nguyên hay là hành vi độc quyền? Hãy chia sẻ quan điểm của bạn ở phần bình luận phía dưới!