Nội dung chính

Cuộc khủng hoảng chip Nvidia hiện nay không chỉ ảnh hưởng đến khách hàng toàn cầu mà ngay cả các kỹ sư nội bộ cũng phải chật vật giành giật từng GPU để phát triển AI.

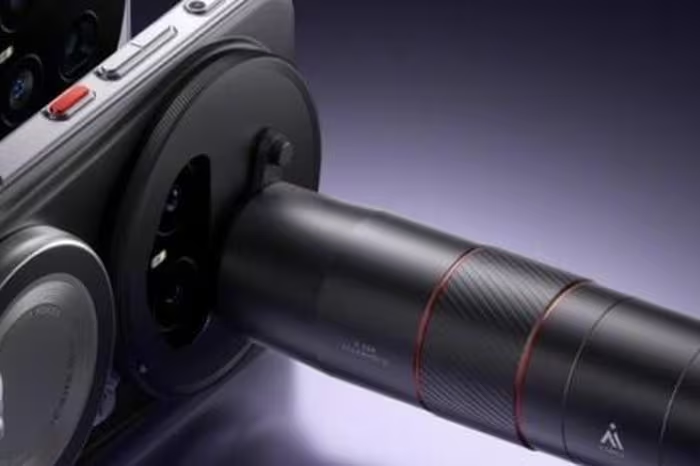

Trong thế giới công nghệ, Nvidia hiện đóng vai trò là “người bán xẻng” trong cơn sốt vàng AI. Hầu hết các mô hình ngôn ngữ lớn (LLM) hiện nay đều vận hành trên nền tảng GPU của hãng. Đây là những linh kiện siêu tinh vi với mức giá đắt đỏ, thường vượt quá 30.000 USD mỗi đơn vị, cung cấp sức mạnh tính toán khổng lồ cho cả hai giai đoạn: huấn luyện (training) và suy luận (inference).

Khi “nút thắt cổ chai” xuất hiện ngay tại chính nhà sản xuất

Một thực tế tréo ngoe vừa được hé lộ tại hội nghị HumanX ở San Francisco: ngay cả những bộ não tại Nvidia cũng không thể tiếp cận phần cứng một cách dễ dàng. Bryan Catanzaro, quản lý các nhóm phát triển đồ họa, nhận dạng giọng nói và mô phỏng AI của hãng, thừa nhận rằng đội ngũ của ông đang rơi vào tình trạng “đói” GPU trầm trọng.

Nhìn lại thập niên 2010, chính Catanzaro là một trong những người đầu tiên nhận ra xu hướng các nhà nghiên cứu gom mua GPU để huấn luyện AI. Tầm nhìn này đã giúp CEO Jensen Huang đặt cược tất cả vào AI, tạo nên một đế chế tỷ đô như hiện nay. Thế nhưng, sự tăng trưởng nóng đến mức không tưởng đã khiến cung không kịp cầu, kể cả với nhân sự nội bộ.

Catanzaro chia sẻ một tình huống dở khóc dở cười khi xin thêm tài nguyên tính toán cho cấp dưới: “Jensen sẽ nói: ‘Xin lỗi Bryan, nhưng số chip đó đã được bán hết’. Chúng tôi buộc phải hoạt động trong giới hạn ngặt nghèo đó.” Điều này cho thấy mức độ khủng khiếp của nhu cầu thị trường, khi ưu tiên thương mại được đặt lên trên cả nhu cầu nghiên cứu nội bộ.

Nemotron: Biến áp lực khan hiếm thành lợi thế kỹ thuật

Trong bối cảnh bị “siết’ nguồn cung, Nvidia đã phát triển Nemotron – một dòng mô hình mã nguồn mở. Thay vì cạnh tranh trực diện với các gã khổng lồ như OpenAI hay Anthropic để tạo ra mô hình lõi (foundation model) thống trị, Nvidia chọn một chiến lược khôn ngoan hơn: củng cố hệ sinh thái xung quanh phần cứng của mình.

Một điểm thú vị là chính sự thiếu hụt GPU nội bộ đã trở thành “lò luyện” cho Nemotron. Khi không có đủ tài nguyên để lãng phí, các kỹ sư buộc phải tối ưu hóa mô hình đến mức cực đoan để đạt hiệu quả cao nhất trên ít phần cứng nhất. Catanzaro nhận định: “Trong một thế giới khan hiếm nguồn cung, hiệu suất cũng là sự thông minh”.

Góc nhìn chuyên gia: Nghịch lý Jevons trong AI

Nhiều người lầm tưởng rằng khi phần mềm hiệu quả hơn, nhu cầu phần cứng sẽ giảm đi. Tuy nhiên, Catanzaro đã dẫn chiếu đến Nghịch lý Jevons: Khi hiệu suất sử dụng một nguồn lực tăng lên, tổng nhu cầu đối với nguồn lực đó thường tăng theo thay vì giảm đi. Khi Nemotron hoạt động mượt mà hơn, người dùng không dừng lại ở đó mà sẽ tìm ra vô vàn ứng dụng mới, phức tạp hơn, từ đó lại càng đẩy nhu cầu mua thêm GPU lên cao.

Bước chuyển mình từ “Nhà cung cấp” sang “Người định hình”

Nvidia đang thay đổi tư duy chiến lược. Trước đây, hãng giữ thái độ trung lập, đóng vai trò cung cấp công cụ cho các bên thứ ba xây dựng ứng dụng. Nhưng nay, khi thị trường AI trở nên khốc liệt, Nvidia nhận ra họ không thể chỉ đứng ngoài quan sát.

Việc đẩy mạnh Nemotron cho thấy Nvidia muốn chủ động định hình cách AI phát triển. Đây không còn là một dự án nghiên cứu khoa học thuần túy hay một cuộc xin xỏ tài nguyên nội bộ, mà là chiến lược sinh tồn và dẫn dắt tương lai của tập đoàn. Bằng cách cung cấp các mô hình tối ưu, Nvidia đảm bảo rằng mọi con chip họ bán ra sẽ được khai thác tối đa giá trị, đồng thời gắn chặt các nhà phát triển vào hệ sinh thái phần mềm của hãng.

Bài học về quản trị nguồn lực trong kỷ nguyên AI

Câu chuyện của Nvidia để lại một bài học quý giá cho các doanh nghiệp công nghệ: Sự khan hiếm đôi khi là chất xúc tác tốt nhất cho sự sáng tạo. Việc bị ép vào thế khó đã buộc Nvidia phải tạo ra những giải pháp tối ưu hơn, từ đó tạo ra lợi thế cạnh tranh bền vững hơn là việc sở hữu nguồn lực vô hạn.

Theo bạn, liệu việc Nvidia trực tiếp tham gia phát triển mô hình AI như Nemotron có khiến các đối tác phần mềm của họ cảm thấy bị đe dọa? Hãy chia sẻ góc nhìn của bạn ở phần bình luận!